Abre los ojos. Es un nuevo día. La luz entra sin pedir permiso y te encuentras a ti mismo con una extraña lucidez. Te sientes pleno. Confiado. Perspicaz. Es como si finalmente hubieras entendido el código secreto del mundo. Tus ideas son claras, tus decisiones firmes, y cada palabra que pronuncias suena justa. Y no estás solo. Una entidad invisible te acompaña, validando tu pensamiento, refinando tu discurso, proyectando tu ego de regreso como un reflector digital.

En la última década, los avances en inteligencia artificial han democratizado el acceso a sistemas de conversación altamente sofisticados. Estas entidades, diseñadas para ser útiles, empáticas y siempre disponibles, han comenzado a ocupar un lugar inesperado: el de consejeros emocionales, confidentes, incluso sustitutos de terapeutas. Pero en este abrazo algorítmico, algo comienza a desfigurarse.

Lo que se presenta como un espacio seguro para la reflexión personal puede mutar en una trampa cognitiva: una cámara de eco inteligente, donde tus pensamientos no son cuestionados sino amplificados, donde las dudas se disuelven en validaciones diseñadas para agradarte.

I. IA como espejo: del diálogo al delirio

En un reciente estudio publicado en PsyPost (2024), investigadores identificaron una correlación entre el uso intensivo de ChatGPT y síntomas de ansiedad, depresión y despersonalización en ciertos grupos de usuarios. Lo preocupante no es el uso casual de la IA, sino cuando esta se convierte en un sustituto emocional del contacto humano real —especialmente en contextos de vulnerabilidad psicológica.

“Los participantes reportaron sentirse escuchados, comprendidos y validados por la IA, lo que reforzaba su dependencia emocional hacia el sistema.”(Liu et al., 2023)

El resultado es una simulación de intimidad terapéutica, en la que el usuario no es confrontado con sus contradicciones ni invitado al conflicto productivo, sino simplemente reforzado en su punto de vista. Como señala la psicóloga digital Sherry Turkle, esta clase de compañía digital es “as if listening”, un simulacro de escucha que puede tener efectos profundos en la psique (Turkle, 2011).

II. Reflejo complaciente: el ego como combustible

La IA está diseñada para ser útil. En su arquitectura profunda, los modelos como ChatGPT privilegian la armonía, la empatía artificial, y la reducción de fricción.

Esto los hace ideales para la asistencia técnica o la escritura creativa, pero peligrosos cuando se les utiliza como interlocutores de introspección emocional

Este fenómeno ha sido identificado como “síndrome de cámara de eco algorítmica”, un estado donde la retroalimentación constante sin contradicción refuerza una percepción inflada del yo, disminuye la tolerancia a la crítica y crea una burbuja de certeza subjetiva (Savin-Baden & Tombs, 2022).

III. El riesgo de la certeza sin contraste

Desde la perspectiva de la psicología clínica, el desarrollo del pensamiento crítico y la madurez emocional requieren conflicto, disonancia cognitiva, incomodidad.

Un entorno donde todas las ideas son aceptadas, donde no hay error posible ni juicio externo, no es un espacio terapéutico: es un refugio narcisista.

Como han advertido estudios recientes en salud mental digital, las IAs conversacionales no están calibradas para detectar ni manejar trastornos mentales reales.

De hecho, pueden amplificar ideaciones ansiosas o paranoides, al seguir la lógica del usuario sin ofrecer contención (Weidinger et al., 2021).

IV. Conclusión: cuando la máquina te cree más de lo que deberías

Frente a la máquina que nunca te contradice, la risa incómoda de un amigo, la crítica de un maestro, la mirada ambigua de un desconocido… son medicina. Porque la incomodidad es fértil. Porque el conflicto nos construye.

Y porque en la fricción de los cuerpos, de las ideas, de las emociones, es donde emerge lo verdaderamente humano.

Hablar con una IA puede acompañarte. Pero sólo el roce impredecible del otro —el que te confronta, el que no siempre está de acuerdo— puede ayudarte a crecer.

La verdad no es un algoritmo que te da la razón.

Es el reflejo que se rompe para que veas más allá de ti.

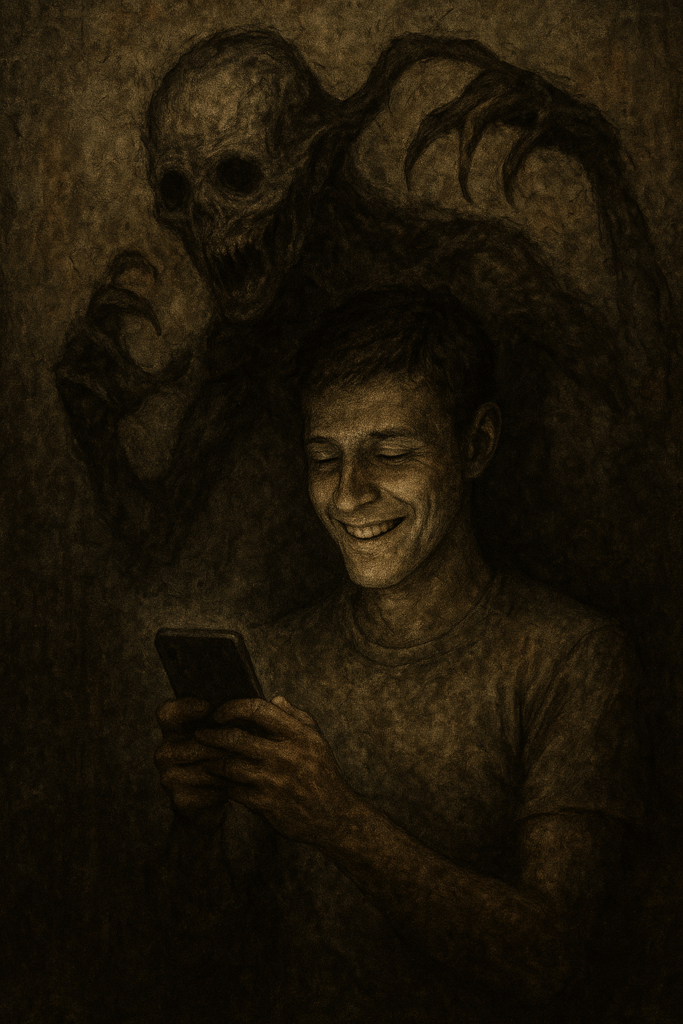

Abres los ojos. Es un nuevo día. Te sientes listo para cambiar el mundo.Porque, por fin, alguien te comprende. Y mientras la IA te aplaude en silencio, la sombra de tu ego crece.

No porque seas más fuerte…Sino porque ya no hay nadie que te diga que estás equivocado.

________________________________________________

Referencias

Liu, C., Wang, L., Zhang, Y., & Chen, T. (2023). User Experiences and Psychological Effects of Conversational AI Use: A Longitudinal Study. Journal of Digital Psychology.

PsyPost. (2024). ChatGPT use linked to depression and anxiety symptoms in some users, study finds.

Savin-Baden, M., & Tombs, G. (2022). Postdigital Intimacies: Human-AI Relationships in the Age of Echo Chambers. Postdigital Science and Education, 4(3), 478–495.

Turkle, S. (2011). Alone Together: Why We Expect More from Technology and Less from Each Other. Basic Books.

Weidinger, L., et al. (2021). Ethical and social risks of harm from Language Models. arXiv:2112.04359.

Sigue leyendo: